Căutare Google Voice

Google este unul dintre pionierii cercetării AI și o multitudine de proiecte au continuat să întoarcă capul. AlphaZero de la Google DeepMind echipa a fost un progres în cercetarea AI, datorită abilității programului de a învăța de la sine jocuri complicate (fără pregătire și intervenție umană). Google a făcut, de asemenea, o muncă excelentă în Programe de procesare a limbajului natural (NLP), care este unul dintre motivele care stau la baza eficienței Asistentului Google în înțelegerea și procesarea vorbirii umane.

Google a anunțat recent lansarea a trei noi FOLOSIȚI module multilingve și oferă mai multe modele multilingve pentru recuperarea textului semantic similar.

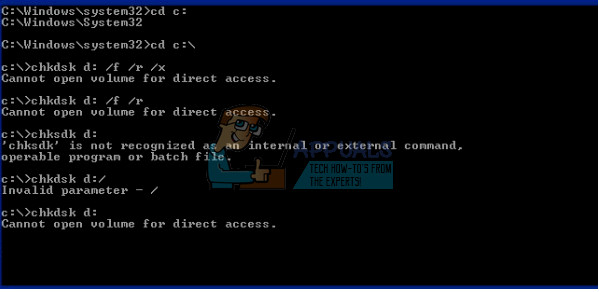

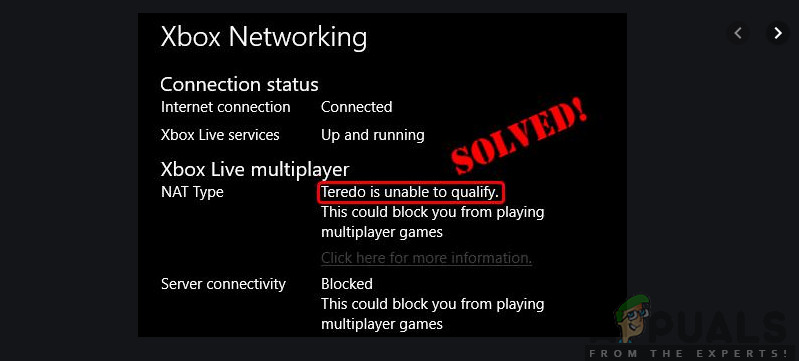

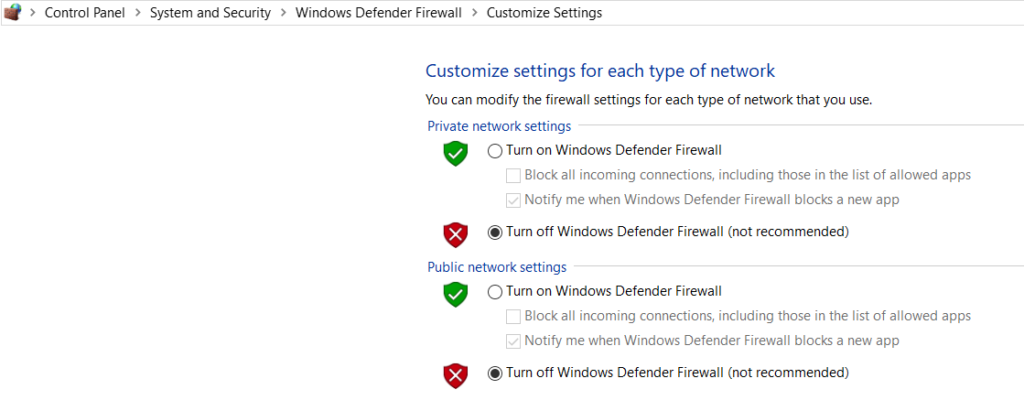

Primele două module oferă modele multilingve pentru recuperarea textului semantic similar, unul optimizat pentru performanță de recuperare și celălalt pentru viteză și mai puțină utilizare a memoriei. Al treilea model este specializat pentru recuperare întrebare-răspuns în șaisprezece limbi (USE-QA) și reprezintă o aplicație complet nouă a USE. Toate cele trei module multilingve sunt instruite folosind un cadru multi-task dual-encoder , similar cu modelul original USE pentru limba engleză, folosind în același timp tehnici pe care le-am dezvoltat pentru îmbunătățirea dual-encoder cu abordare softmax cu margine aditivă . Acestea sunt concepute nu numai pentru a menține o bună performanță de învățare prin transfer, ci pentru a efectua bine sarcini de recuperare semantică.

Procesarea limbajului în sisteme a parcurs un drum lung, de la analiza de bază a arborelui sintaxic la modele mari de asociere vectorială. Înțelegerea contextului în text este una dintre cele mai mari probleme din câmpul NLP, iar codificatorul universal de propoziții rezolvă acest lucru prin conversia textului în vectori cu dimensiuni ridicate, ceea ce face mai ușoară clasificarea și denotarea textului.

Sursa structurii de marcare UTE - Google Blog

Potrivit Google, „ Cele trei module noi sunt toate construite pe arhitectura de recuperare semantică, care împarte de obicei codificarea întrebărilor și răspunsurilor în rețele neuronale separate, ceea ce face posibilă căutarea între miliarde de răspunsuri potențiale în milisecunde. Cu alte cuvinte, acest lucru ajută la o mai bună indexare a datelor.

' Toate cele trei module multilingve sunt instruite folosind un cadru multi-task dual-encoder , similar cu modelul original USE pentru limba engleză, folosind în același timp tehnici pe care le-am dezvoltat pentru îmbunătățirea dual-encoder cu abordare softmax de marjă aditivă . Acestea sunt concepute nu numai pentru a menține o bună performanță de învățare prin transfer, ci pentru a efectua bine sarcini de recuperare semantică . ” Funcția Softmax este adesea utilizată pentru a economisi puterea de calcul prin exponențierea vectorilor și apoi împărțirea fiecărui element la suma exponențialei.

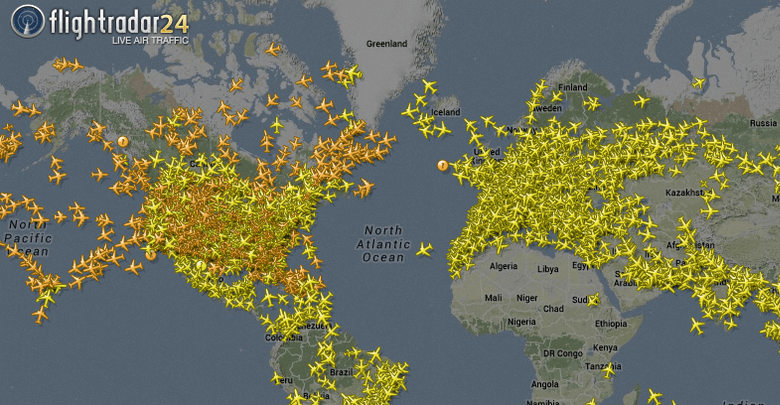

Arhitectura de recuperare semantică

„Cele trei module noi sunt toate construite pe arhitecturi de recuperare semantică, care împart de obicei codificarea întrebărilor și răspunsurilor în rețele neuronale separate, ceea ce face posibilă căutarea între miliarde de răspunsuri potențiale în decurs de milisecunde. Cheia utilizării codificatoarelor duale pentru regăsirea semantică eficientă este pre-codificarea tuturor răspunsurilor candidate la interogările de intrare așteptate și stocarea lor într-o bază de date vectorială care este optimizată pentru rezolvarea cea mai apropiată problemă de vecin , ceea ce permite ca un număr mare de candidați să fie căutați rapid și bine precizie și rechemare . '

Puteți descărca aceste module din TensorFlow Hub. Pentru lecturi suplimentare, consultați versiunea completă GoogleAI postare pe blog .

Etichete Google